Trust Center IA di GoTo

Ultima modifica: 3 marzo 2025

Introduzione

GoTo offre ai clienti strumenti che li aiutano ad aumentare la loro produttività ed efficienza, integrando servizi di intelligenza artificiale (IA) nei nostri prodotti di comunicazione aziendale, collaborazione, assistenza remota e gestione IT ("Servizi di GoTo").

Utilizziamo i Large Language Models (LLM) e i modelli fondamentali dell’IA per supportare un numero crescente di casi d’uso nei nostri Servizi di GoTo, come gli assistenti interattivi basati sull’IA, i suggerimenti per la risoluzione dei problemi IT, la creazione e l’analisi di script di gestione IT, la sintesi di riunioni e chiamate e la fornitura di approfondimenti aziendali operativi.

Sebbene l’IA offra vantaggi significativi, è anche una tecnologia in rapida evoluzione che presenta rischi potenziali. In questa pagina, spieghiamo l’approccio di GoTo alle pratiche di sviluppo sicure, progettate per gestire questi rischi e aiutare i nostri clienti a trarre vantaggio dalle caratteristiche e dalle funzionalità basate sull’IA.

La privacy e la sicurezza hanno un ruolo di primo piano quando GoTo progetta qualsiasi funzione di intelligenza artificiale. Per ulteriori informazioni sui programmi di privacy e sicurezza di GoTo, visita il nostro Trust Center.

Uso responsabile dell’IA in GoTo

GoTo si impegna a utilizzare in modo responsabile l’intelligenza artificiale per fornire funzionalità del prodotto che promuovano l’efficienza, pur proteggendo dal rischio di conseguenze non etiche o dannose. Per questo motivo, le caratteristiche dei nostri prodotti abilitati all’IA sono progettate tenendo conto dei principi dell’IA responsabile:

- Equità. Protezione contro risultati falsati o discriminatori, compresa la riduzione al minimo dell’uso di input di dati che possono portare a un comportamento discriminatorio del modello.

- Trasparenza. I clienti e gli utenti finali sanno che stanno interagendo con l’IA e che stanno utilizzando funzionalità abilitate dall’IA. GoTo spiega come e dove l’IA viene incorporata nei prodotti e come funziona.

- Responsabilità. Vengono implementati meccanismi di supervisione e revisione per identificare i risultati inattesi o dannosi. Le funzionalità sono progettate per consentire la supervisione e il controllo da parte dell’uomo in modo commisurato ai rischi e alla natura della funzionalità abilitata dall’IA.

- Privacy e sicurezza. GoTo implementa progetti di sistemi robusti con test e monitoraggi regolari per proteggere i dati. Il concetto di “privacy by design” è incorporato nella progettazione delle funzioni abilitate dall’intelligenza artificiale, che sono concepite per elaborare solo la quantità minima di dati necessaria per raggiungere il loro scopo.

- Uso etico. L’IA viene utilizzata per scopi positivi e non dannosi. Sono stati implementati controlli per proteggere da errori generativi dell’IA, disinformazione, imprecisioni, violazioni dei diritti umani e altri risultati potenzialmente dannosi.

Principio fondamentale: il nostro modello di fiducia alla base dell’IA

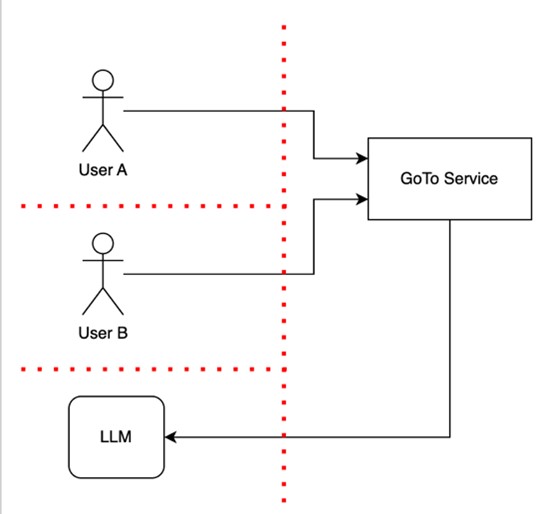

L’approccio di GoTo alla progettazione delle funzionalità basate sull’IA prevede l’implementazione di barriere per la fiducia per separare i dati degli utenti sia tra loro che dall’infrastruttura del prodotto. Questo modello di fiducia si fonda sull’assunto che un’infrastruttura considerata sicura non possa includere né esseri umani né modelli IA all’interno dello stesso perimetro di fiducia, come illustrato nel diagramma sottostante.

Nel diagramma, vengono mostrati due utenti, Utente A e Utente B, che utilizzano un servizio GoTo contenente una funzionalità basata su un LLM (Large Language Model o modello linguistico di grandi dimensioni), indicata con una freccia che punta verso l’LLM. La linea rossa rappresenta le barriere di fiducia, progettate per proteggere informazioni sensibili e funzionalità, separando gli utenti tra loro e dall’infrastruttura del prodotto, incluso il modello IA. Queste barriere abilitano controlli di fiducia (come autenticazione, autorizzazione e verifiche di coerenza) ogni volta che flussi di controllo o dati le attraversano.

Come mostra questo diagramma, l’Utente B non ha accesso ai dati o ai dispositivi dell’Utente A.

Questo modello di fiducia aiuta a proteggere i dati dei clienti da accessi o utilizzi non autorizzati e contribuisce a difendere i servizi di GoTo da attacchi o vulnerabilità.

Meccanismi di tutela

Quando progetta applicazioni basate su LLM o funzionalità che sfruttano l’LLM, GoTo si mantiene informata sui rischi specifici legati all’LLM e su altri rischi correlati all’IA, come l’introduzione di prompt, la contaminazione dei dati di addestramento e le vulnerabilità della catena di approvvigionamento, implementando misure di tutela per affrontarli. Tenendo conto del modello di fiducia di GoTo e dei rischi generali legati all’IA, vengono utilizzati diversi meccanismi, descritti di seguito, come il controllo umano e la multi-tenancy, progettati per aiutare gli utenti a beneficiare delle applicazioni e delle funzionalità IA in modo sicuro per i dati.

Sebbene i modelli di IA offrano strumenti preziosi per automatizzare attività, rispondere a domande e generare contenuti, è importante ricordare che questi modelli si differenziano dai tradizionali software poiché possono produrre risposte errate o output indesiderati. Quando si utilizzano applicazioni basate sull’IA, il livello di fiducia nei confronti degli output generati dai modelli di IA (incluso l’LLM) dovrebbe essere simile a quello che si avrebbe nei confronti dei contenuti creati da altri utenti. In sintesi, fidarsi ma verificare: è sempre consigliabile controllare l’accuratezza e la completezza dei risultati prodotti dall’IA in risposta ai propri prompt.

Tenendo presente quanto sopra, quando l’intelligenza artificiale viene integrata nei Servizi di GoTo, vengono implementati, ove opportuno, i seguenti meccanismi di salvaguardia:

- Controllo umano. Le funzionalità abilitate all’IA sono progettate per garantire che l’utente abbia sempre l’ultima parola sull’utilizzo e la modalità di utilizzo degli output generati da un modello di IA (come un LLM). Gli utenti dei prodotti GoTo restano al comando e le azioni sensibili richiedono l’approvazione umana.

- Multi-Tenancy con LLM. GoTo assicura che ogni utente abbia sessioni (conversazioni) separate con il servizio LLM, non accessibili ad altri utenti. Questo significa che le informazioni sensibili condivise accidentalmente in un prompt non possono essere visualizzate da altri.

- I dati dei clienti non vengono utilizzati da terze parti per addestrare i loro LLM. Quando GoTo fornisce funzionalità IA tramite fornitori terzi, a questi è espressamente vietato utilizzare i dati dei clienti GoTo per fini di addestramento dei propri modelli.

- Validazione di input e output. I servizi GoTo convalidano il formato degli input utilizzando tecniche comuni di validazione, come espressioni regolari e parser. I servizi rifiutano determinati tipi di input e output inattesi in base ai risultati della validazione, al fine di ridurre i rischi per la sicurezza, prevenire la perdita o la corruzione dei dati e minimizzare gli errori. Ad esempio, vengono filtrati input e output che appaiono come iniezioni testuali, prompt non pertinenti, dati corrotti o casi di errore non forzato.

Trasparenza: utilizzo di funzionalità IA

Ci impegniamo a identificare in modo chiaro le funzionalità abilitate all’IA nei Servizi di GoTo. Ad esempio, evidenziamo le funzionalità che utilizzano l’IA tramite indicazioni testuali o mediante un’icona a forma di stellina, come mostrato qui sotto. I nostri clienti possono scegliere se utilizzare o meno la funzionalità o l’output generato. In alcuni casi, i clienti o gli utenti hanno la possibilità di disattivare le funzionalità abilitate all’IA che non desiderano utilizzare. Ti invitiamo a consultare le pagine di supporto specifiche del prodotto per ulteriori informazioni.

Esempi di identificazione delle funzionalità con IA:

Trasparenza: uso dei dati

In casi limitati, e solo laddove i clienti abbiano la possibilità di scegliere in merito a tale utilizzo, GoTo può utilizzare i dati dei clienti per addestrare i propri modelli di IA e contribuire a migliorare la qualità complessiva degli output del prodotto. Per i clienti che scelgono di consentire questo utilizzo dei dati, GoTo adotta misure per elaborare solo le informazioni necessarie, limitando le richieste al modello LLM ai soli dettagli contestuali essenziali, come ulteriormente spiegato nella sezione “Minimizzazione dei dati”. Un esempio di questo approccio è illustrato nelle FAQ sull’utilizzo dei contenuti utente di LogMeIn Resolve.

Forniamo ulteriori informazioni sull’utilizzo delle funzionalità abilitate all’IA nei prodotti GoTo nei Termini per l’IA di GoTo, che si applicano all’utilizzo di tali funzionalità da parte del cliente.

Minimizzazione dei dati

GoTo cerca di limitare le richieste del modello LLM ai dettagli contestuali essenziali. Ad esempio, se un cliente desidera includere dettagli contestuali in un input per un modello LLM per migliorarne la precisione, i servizi GoTo cercano di utilizzare solo le informazioni rilevanti nel contesto utilizzando una tecnica chiamata Retrieval Augmented Generation (RAG). Ad esempio, durante la diagnosi di un dispositivo in LogMeIn Resolve o Rescue, includiamo dati relativi al dispositivo, come la CPU e la memoria, ma evitiamo qualsiasi dato personale sugli utenti del dispositivo.

Minimo privilegio e rischio basato sulla funzionalità

Nel progettare i servizi GoTo, incluse le funzionalità abilitate all’IA, adottiamo un approccio basato sul rischio e il principio del minimo privilegio. Ciò significa che un servizio IA ha accesso solo ai dati o alle risorse specificamente necessari (ad esempio, limitiamo tecnicamente l’accesso ai dati usando ruoli tecnici con privilegi ristretti).

Prima di decidere di implementare una funzionalità abilitata all’IA, valutiamo i rischi specifici legati a quella funzionalità. Per limitare l’accesso in modo appropriato, riduciamo i privilegi e i dati accessibili al servizio IA a ciò che è strettamente necessario per il funzionamento della funzionalità.